Hicieron una encuesta a 346 organizaciones sociales en diciembre de 2025 y analizaron cómo el tercer sector está adoptando la inteligencia artificial y el impacto que genera tanto en los equipos como en los resultados.

Según esta investigación, el uso de las herramientas de inteligencia artificial es casi total. El 92% de las organizaciones dicen que utilizan alguna herramienta de inteligencia artificial en alguno de lsus procesos pero advierte que hay una diferencia muy grande entre el uso que tienen y la transformación que generan dentro de las organizaciones.

Un 79% de las organizaciones encuestadas dice que solo tuvieron algunas pequeñas mejoras y solo un 7% dice que lograron mejoras organizacionales significativas, es decir, que tuvieron impactos estratégicos que sirvieron para ampliar sus capacidades o sus resultados, como por ejemplo, escalar fuertemente la personalización a sus donantes o duplicar la capacidad de investigación que tienen sus equipos.

Hasta ahora la mayoría de las organizaciones dice estar en una etapa experimental:

- El 65 % describe su uso como reactivo e individual.

- El 18 % tiene flujos de trabajo repetibles a nivel equipo.

- Solo 7 % cuenta con una integración estratégica alineada a metas, presupuestos y KPIs.

Además en el informe se ven algunos problemas estructurales:

- El 81 % usa IA de forma ad hoc, sin coordinación transversal.

- Solo 4 % tiene workflows documentados y repetibles.

- 47 % no cuenta con una política de gobernanza de IA, lo que implica riesgos en términos de ética, privacidad y responsabilidad.

Las organizaciones reportan un uso limitado mayoritariamente a algunas áreas y tareas:

- Comunicación con donantes y creación de contenidos (62 %)

- Marketing y redes sociales (60 %)

- Emails y creatividad (60 %)

- Análisis de datos y reportes (42 %)

El Desafío de la IA para las ONGs

Leyendo el informe encontré que el desafío principal que destaca es similar al que veo en mi trabajo como líder de mi agencia Guaraní y como presidente de AEDROS al charlar con mis colegas fundraisers de América Latina y Europa.

Lo que está en discusión en el tercer sector ya no es si van a usar inteligencia artificial o no, sino cómo es la mejor forma de integrarla estratégicamente.¿Cómo pueden desarrollar un sistema de gobernanza, de uso, de capacitación de su staff, de métricas claras y de alineación organizacional?

En nuestro trabajo como consultores, muchas veces encontramos organizaciones que dicen prohibir a sus empleados o a sus voluntarios usar herramientas de inteligencia artificial, pero la mayoría de ellos ya las están usando sin tener una política clara en temas claves, como por ejemplo la privacidad de los datos. Además, hay mucha información y conocimiento que queda desperdiciado al distribuirse entre muchísimas herramientas diferentes sin ninguna sistematicidad ni control por parte de la organización.

Esta experiencia personal queda también refrendada por los resultados del informe que dice que casi la mitad de las organizaciones encuestadas (47 %) no tiene ninguna política formal de gobernanza de IA. Esto significa que no existen lineamientos claros sobre qué datos están permitidos para usar con IA, cómo se protegen ni quién es responsable de esa supervisión.

El informe subraya que la ausencia de políticas de IA y gobernanza puede limitar la capacidad de las organizaciones para escalar el uso de IA de manera segura, lo que incluye manejar datos de donantes o información sensible de forma ética y conforme a regulaciones.

¿Qué camino debemos tomar las Organizaciones sociales respecto a la Inteligencia Artificial?

Hace algunos días, mi colega y mentor Marcelo Iñarra se preguntaba qué camino teníamos que tomar las organizaciones sociales y ponía el foco en la mirada ética sobre la utilización de las herramientas de inteligencia artificial.

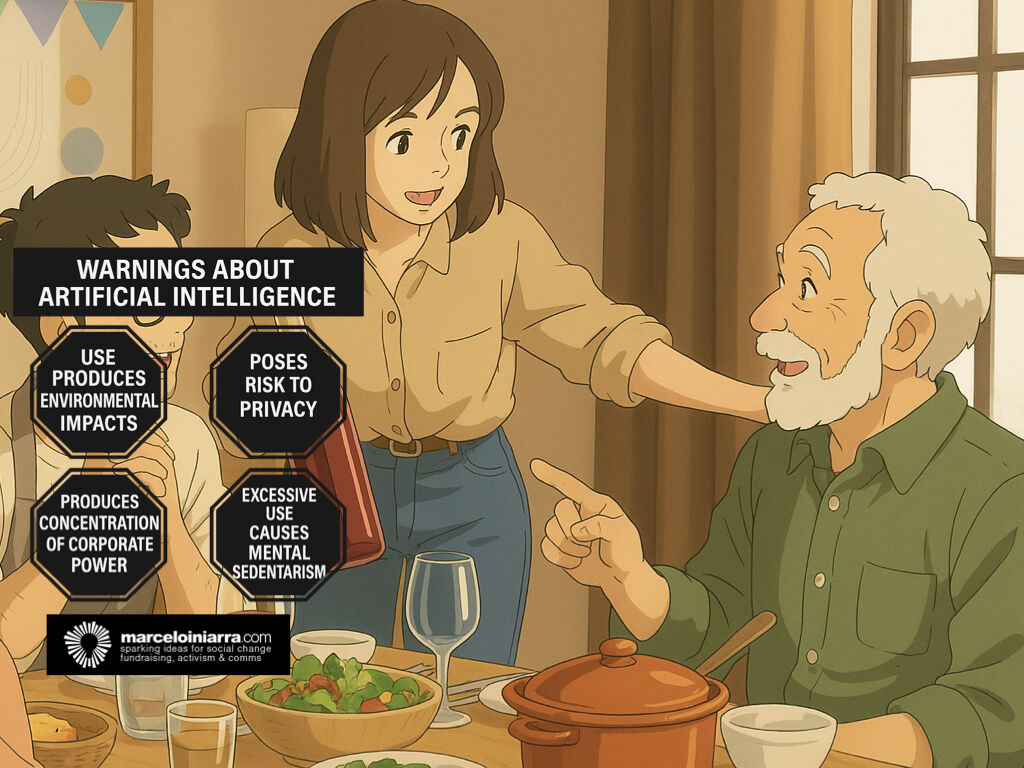

Marcelo, destacando que su mirada tiene la identidad clave de ser parte del “Sur Global”, pero trabajando en realidades diversas y horizontales, presentaba una campaña de “etiquetado de advertencia en IA”, similar a las etiquetas que alertan sobre ingredientes dañinos en productos alimenticios en América Latina. Según Marcelo, esta campaña podría ayudar a abrir conversaciones más profundas sobre los riesgos de concentración de poder, impactos ambientales, amenazas a la privacidad y sedentarismo mental.

A esta invitación a la reflexión, yo le respondí:

Como bien decís, esta ola parece imparable, especialmente cuando vemos los beneficios. Ver los beneficios es simple: mayor eficiencia, menores costos, mejores resultados.

Pero los costos son más difíciles de ver. Porque están ocultos.

Nos hablan de “la nube” en lugar de hablar de datacenters.

Nos hablan de “inteligencia artificial” en lugar de modelos predictivos.Los algoritmos que mencionás no fueron diseñados desde cero.

Son el resultado de la cristalización de determinadas dinámicas de poder. Y también lo son los datos con los que fueron entrenados.Hasta ahora, estos grupos poderosos han sido muy hábiles para enmascarar muchas de las cosas que nos venden y que compramos, quizás en un intento de no quedarnos atrás frente a otros y no perder oportunidades.

El problema, amigo mío, es que estamos siendo derrotados de muchas maneras.

¿Charlamos sobre Inteligencia Artificial? ¿Sobre Desarrollo de fondos?

Si vos o tu organización necesitan desarrollar estrategias de comunicación y fundraising integrando herramientas de Inteligencia Artificial o adaptandose a los cambios que implican en este nuevo escenario te invito a contactarse conmigo. También te invito a seguirme en Linkedin. Allí, publico asiduamente contenido sobre el tema. También podés suscribirte a mi newsletter entrando aquí.

Si querés charlar más y compartir experiencias y aprendizajes sobre la inteligencia artificial te invito a sumarte a nuestro grupo de Facebook sobre el tema. Hacé click aquí.

Subscribite en LinkedIn